Материалы по тегу: open source

|

24.03.2025 [08:30], Владимир Мироненко

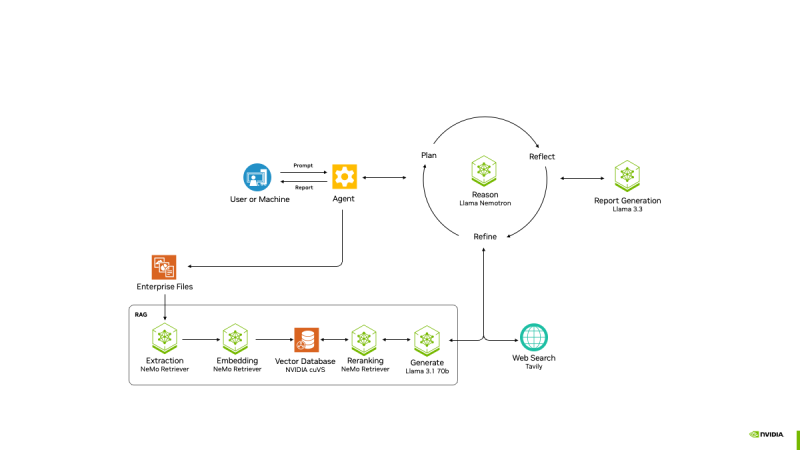

NVIDIA представила проект AI-Q Blueprint Platform для создания продвинутых ИИ-агентовПризнавая, что одних моделей, включая свежие Llama Nemotron с регулируемым «уровнем интеллекта», недостаточно для развёртывания ИИ на предприятии, NVIDIA анонсировала проект AI-Q Blueprint, представляющий собой фреймворк с открытым исходным кодом, позволяющий разработчикам подключать базы знаний к ИИ-агентам, которые могут действовать автономно. Blueprint был создан с помощью микросервисов NVIDIA NIM и интегрируется с NVIDIA NeMo Retriever, что упрощает для ИИ-агентов извлечение мультимодальных данных в различных форматах. С помощью AI-Q агенты суммируют большие наборы данных, генерируя токены в 5 раз быстрее и поглощая данные петабайтного масштаба в 15 раз быстрее с лучшей семантической точностью. Проект основан на новом наборе инструментов NVIDIA AgentIQ для бесшовного, гетерогенного соединения между агентами, инструментами и данными, опубликованном на GitHub. Он представляет собой программную библиотеку с открытым исходным кодом для подключения, профилирования и оптимизации команд агентов ИИ, работающих на основе корпоративных данных для создания многоагентных комплексных (end-to-end) систем. Его можно легко интегрировать с существующими многоагентными системами — как по частям, так и в качестве комплексного решения — с помощью простого процесса адаптации, который обеспечивает полную поддержку. Набор инструментов AgentIQ также повышает прозрачность с полной отслеживаемостью и профилированием системы, что позволяет организациям контролировать производительность, выявлять неэффективность и иметь детальное представление о том, как генерируется бизнес-аналитика. Эти данные профилирования можно использовать с NVIDIA NIM и библиотекой с открытым исходным кодом NVIDIA Dynamo для оптимизации производительности агентских систем. Благодаря этим инструментам предприятиям будет проще объединять команды ИИ-агентов в таких решениях, как Agentforce от Salesforce, поиск Atlassian Rovo в Confluence и Jira, а также ИИ-платформа ServiceNow для трансформации бизнеса, чтобы устранить разрозненность, оптимизировать задачи и сократить время ответа с дней до часов. AgentIQ также интегрируется с такими фреймворками и инструментами, как CrewAI, LangGraph, Llama Stack, Microsoft Azure AI Agent Service и Letta, позволяя разработчикам работать в своей предпочтительной среде. Azure AI Agent Service интегрирован с AgentIQ для обеспечения более эффективных агентов ИИ и оркестровки многоагентных фреймворков с использованием семантического ядра, которое полностью поддерживается в AgentIQ. Возможности ИИ-агентов уже широко используются в различных отраслях. Например, платёжная система Visa использует ИИ-агентов для оптимизации кибербезопасности, автоматизируя анализ фишинговых писем в масштабе. Используя функцию профилирования AI-Q, Visa может оптимизировать производительность и затраты агентов, максимально увеличивая роль ИИ в эффективном реагировании на угрозы, сообщила NVIDIA.

24.03.2025 [01:37], Владимир Мироненко

NVIDIA анонсировала ИИ-модели Llama Nemotron с регулируемым «уровнем интеллекта»NVIDIA анонсировала новое семейство ИИ-моделей Llama Nemotron с расширенными возможностями рассуждения. Основанные на моделях Llama с открытым исходным кодом от Meta✴ Platforms, модели от NVIDIA предназначены для предоставления разработчикам основы для создания продвинутых ИИ-агентов, которые могут от имени своих пользователей независимо или с минимальным контролем работать в составе связанных команд для решения сложных задач. «Агенты — это автономные программные системы, предназначенные для рассуждений, планирования, действий и критики своей работы», — сообщила Кари Бриски (Kari Briski), вице-президент по управлению программными продуктами Generative AI в NVIDIA на брифинге с прессой, пишет VentureBeat. «Как и люди, агенты должны понимать контекст, чтобы разбивать сложные запросы, понимать намерения пользователя и адаптироваться в реальном времени», — добавила она. По словам Бриски, взяв Llama за основу, NVIDIA оптимизировала модель с точки зрения требований к вычислениям, сохранив точность ответов. NVIDIA сообщила, что улучшила новое семейство моделей рассуждений в ходе дообучения, чтобы улучшить многошаговые математические расчёты, кодирование, рассуждения и принятие сложных решений. Это позволило повысить точность ответов моделей до 20 % по сравнению с базовой моделью и увеличить скорость инференса в пять раз по сравнению с другими ведущими рассуждающими open source моделями. Повышение производительности инференса означают, что модели могут справляться с более сложными задачами рассуждений, имеют расширенные возможности принятия решений и позволяют сократить эксплуатационные расходы для предприятий, пояснила компания. Модели Llama Nemotron доступны в микросервисах NVIDIA NIM в версиях Nano, Super и Ultra. Они оптимизированы для разных вариантов развёртывания: Nano для ПК и периферийных устройств с сохранением высокой точности рассуждения, Super для оптимальной пропускной способности и точности при работе с одним ускорителем, а Ultra — для максимальной «агентской точности» в средах ЦОД с несколькими ускорителями. Как сообщает NVIDIA, обширное дообучение было проведено в сервисе NVIDIA DGX Cloud с использованием высококачественных курируемых синтетических данных, сгенерированных NVIDIA Nemotron и другими открытыми моделями, а также дополнительных курируемых наборов данных, совместно созданных NVIDIA. Обучение включало 360 тыс. часов инференса с использованием ускорителей H100 и 45 тыс. часов аннотирования человеком для улучшения возможностей рассуждения. По словам компании, инструменты, наборы данных и методы оптимизации, используемые для разработки моделей, будут в открытом доступе, что предоставит предприятиям гибкость в создании собственных пользовательских рвссуждающих моделей. Одной из ключевых функций NVIDIA Llama Nemotron является возможность включать и выключать опцию рассуждения. Это новая возможность на рынке ИИ, утверждает компания. Anthropic Claude 3.7 имеет несколько схожую функциональность, хотя она является закрытой проприетарной моделью. Среди моделей с открытым исходным кодом IBM Granite 3.2 тоже имеет переключатель рассуждений, который IBM называет «условным рассуждением». Особенность гибридного или условного рассуждения заключается в том, что оно позволяет системам исключать вычислительно затратные этапы рассуждений для простых запросов. NVIDIA продемонстрировала, как модель может задействовать сложные рассуждения при решении комбинаторной задачи, но переключаться в режим прямого ответа для простых фактических запросов. NVIDIA сообщила, что целый ряд партнёров уже использует модели Llama Nemotron для создания новых мощных ИИ-агентов. Например, Microsoft добавила Llama Nemotron и микросервисы NIM в Microsoft Azure AI Foundry. SAP SE использует модели Llama Nemotron для улучшения возможностей своего ИИ-помощника Joule и портфеля решений SAP Business AI. Кроме того, компания использует микросервисы NVIDIA NIM и NVIDIA NeMo для повышения точности завершения кода для языка ABAP. ServiceNow использует модели Llama Nemotron для создания ИИ-агентов, которые обеспечивают повышение производительности и точности исполнения задач предприятий в различных отраслях. Accenture сделала рассуждающие модели NVIDIA Llama Nemotron доступными на своей платформе AI Refinery. Deloitte планирует включить модели Llama Nemotron в свою недавно анонсированную платформу агентского ИИ Zora AI. Atlassian и Box также работают с NVIDIA, чтобы гарантировать своим клиентам доступ к моделям Llama Nemotron.

21.03.2025 [10:09], Владимир Мироненко

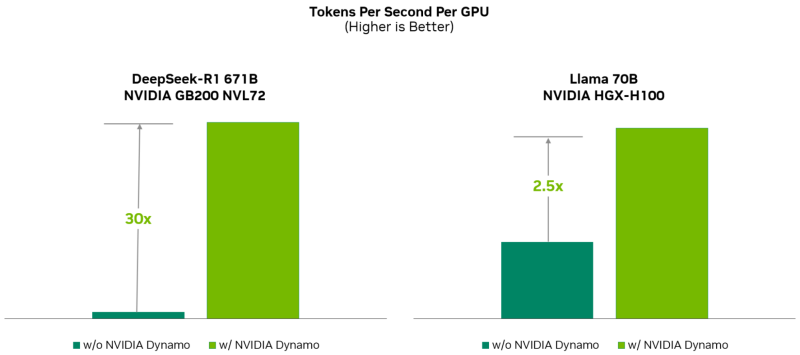

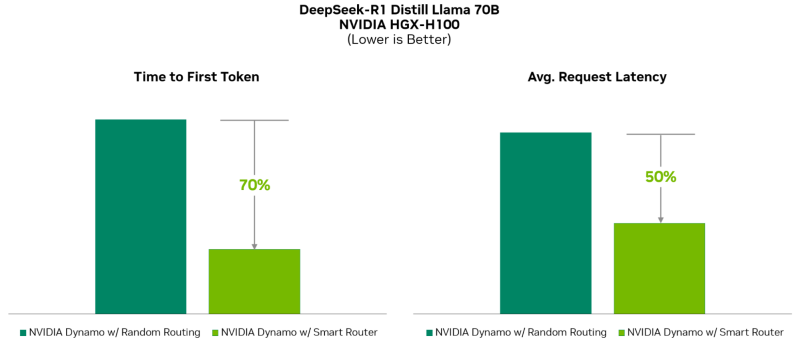

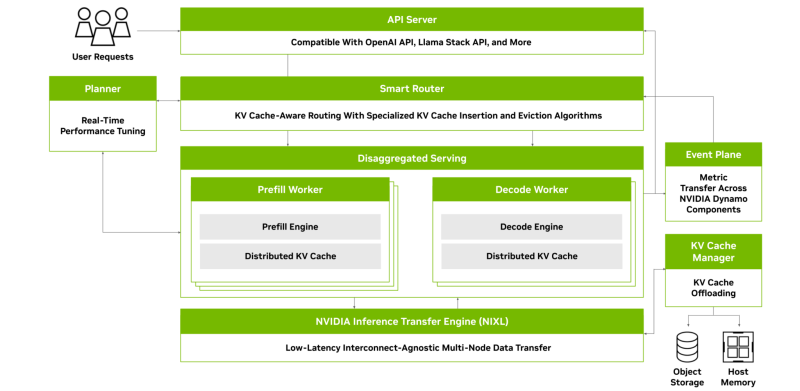

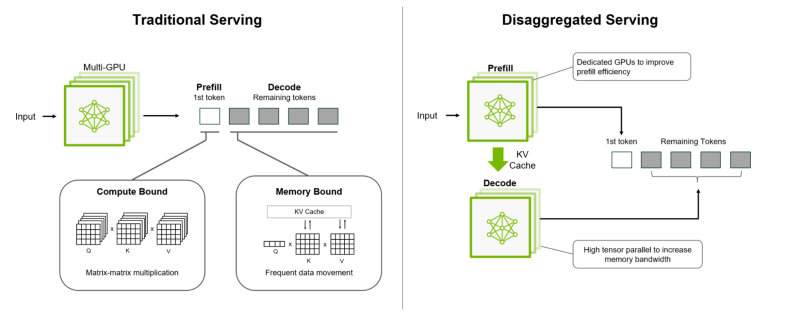

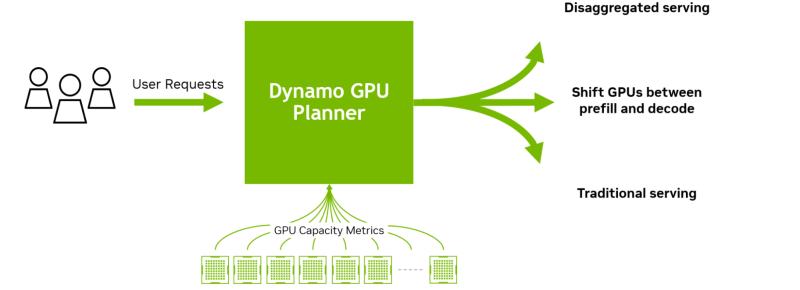

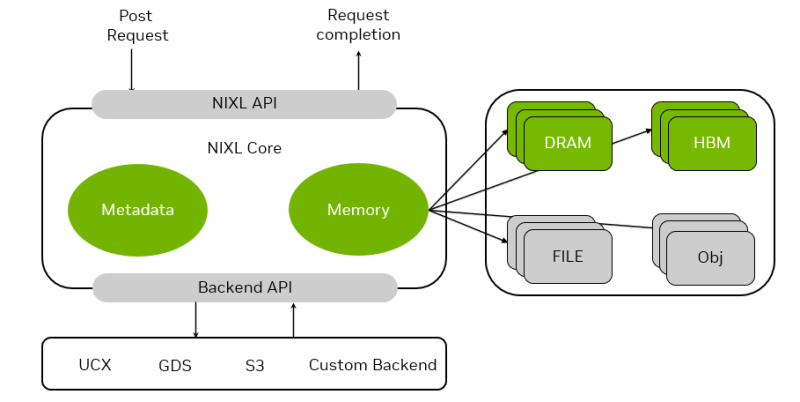

«ОС» для ИИ-фабрик: NVIDIA Dynamo ускорит инференс и упростит масштабирование рассуждающих ИИ-моделейNVIDIA представила NVIDIA Dynamo, преемника NVIDIA Triton Inference Server — программную среду с открытым исходным кодом для разработчиков, обеспечивающую ускорение инференса, а также упрощающую масштабирование рассуждающих ИИ-моделей в ИИ-фабриках с минимальными затратами и максимальной эффективностью. Глава NVIDIA Дженсен Хуанг (Jensen Huang) назвал Dynamo «операционной системой для ИИ-фабрик». NVIDIA Dynamo повышает производительность инференса, одновременно снижая затраты на масштабирование вычислений во время тестирования. Сообщается, что благодаря оптимизации инференса на NVIDIA Blackwell эта платформа многократно увеличивает производительность рассуждающей ИИ-модели DeepSeek-R1. Платформа NVIDIA Dynamo, разработанная для максимизации дохода от токенов для ИИ-фабрик (ИИ ЦОД), организует и ускоряет коммуникацию инференса на тысячах ускорителей, и использует дезагрегированную обработку данных для разделения фаз обработки и генерации больших языковых моделей (LLM) на разных ускорителях. Это позволяет оптимизировать каждую фазу независимо от её конкретных потребностей и обеспечивает максимальное использование вычислительных ресурсов. При том же количестве ускорителей Dynamo удваивает производительность (т.е. фактически доход ИИ-фабрик) моделей Llama на платформе NVIDIA Hopper. При запуске модели DeepSeek-R1 на большом кластере GB200 NVL72 благодаря интеллектуальной оптимизации инференса с помощью NVIDIA Dynamo количество генерируемых токенов на каждый ускоритель токенов увеличивается более чем в 30 раз, сообщила NVIDIA. NVIDIA Dynamo может динамически перераспределять нагрузку на ускорители в ответ на меняющиеся объёмы и типы запросов, а также закреплять задачи за конкретными ускорителями в больших кластерах, что помогает минимизировать вычисления для ответов и маршрутизировать запросы. Платформа также может выгружать данные инференса в более доступную память и устройства хранения данных и быстро извлекать их при необходимости. NVIDIA Dynamo имеет полностью открытый исходный код и поддерживает PyTorch, SGLang, NVIDIA TensorRT-LLM и vLLM, что позволяет клиентам разрабатывать и оптимизировать способы запуска ИИ-моделей в рамках дезагрегированного инференса. По словам NVIDIA, это позволит ускорить внедрение решения на различных платформах, включая AWS, Cohere, CoreWeave, Dell, Fireworks, Google Cloud, Lambda, Meta✴, Microsoft Azure, Nebius, NetApp, OCI, Perplexity, Together AI и VAST. NVIDIA Dynamo распределяет информацию, которую системы инференса хранят в памяти после обработки предыдущих запросов (KV-кеш), на множество ускорителей (до тысяч). Затем платформа направляет новые запросы на те ускорители, содержимое KV-кеша которых наиболее близко к новому запросу, тем самым избегая дорогостоящих повторных вычислений. NVIDIA Dynamo также обеспечивает дезагрегацию обработки входящих запросов, которое отправляет различные этапы исполнения LLM — от «понимания» запроса до генерации — разным ускорителям. Этот подход идеально подходит для рассуждающих моделей. Дезагрегированное обслуживание позволяет настраивать и выделять ресурсы для каждой фазы независимо, обеспечивая более высокую пропускную способность и более быстрые ответы на запросы. NVIDIA Dynamo включает четыре ключевых механизма:

Платформа NVIDIA Dynamo будет доступна в микросервисах NVIDIA NIM и будет поддерживаться в будущем выпуске платформы NVIDIA AI Enterprise.

06.03.2025 [18:45], Владимир Мироненко

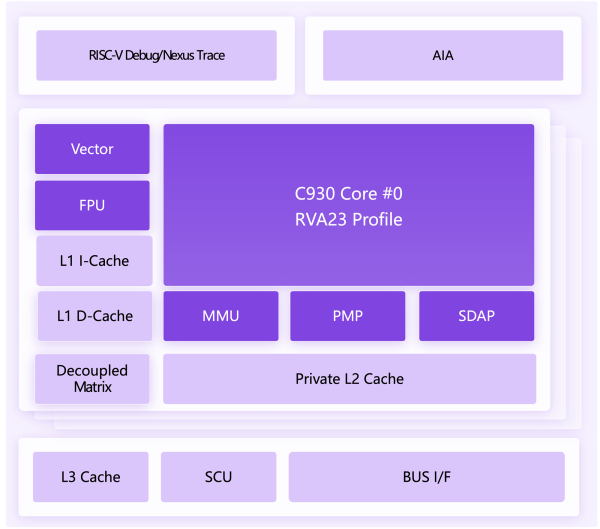

Китай запустит программу господдержки разработки и внедрения чипов RISC-VАрхитектура RISC-V с открытым исходным кодом, похоже, набирает значительную популярность в Китае, сделал вывод ресурс The Register, назвав в качестве свежего примера анонс процессора XuanTie C930, созданного НИИ Damo Academy (Alibaba Group Holding). Ядро C930 позиционируется как идеальное решение для серверов, ПК и автономных автомобилей. Особенно важно соответствие профилю RVA23, поскольку это краеугольный камень экосистемы RISC-V. В частности, профиль определяет расширения для гипервизора, которые являются практически необходимыми для серверных и облачных CPU. Как сообщает XuanTie, «C930 использует передовую микроархитектуру для достижения высокой производительности, включая алгоритм прогнозирования ветвлений на основе TAGE, индивидуальный кеш L2, регулируемый механизм предварительной выборки данных и т. д. Показатель производительности C930 в тесте Specint2006 превышает 15/ГГц». Сообщается, что «типичная конфигурация одного кластера поддерживает четыре ядра» с 64 Кбайт кеша инструкций и данных и L2-кешем на 1 Мбайт. Векторный блок поддерживает расширение RISC-V Vector 1.0, обрабатывает 256-бие векторные регистры и поддерживает вычисления в формате FP16/BF16/FP32/FP64/INT8/INT16/INT32/INT64. Также упомянут блок матричных вычислений. В ходе презентации чипа топ-менеджеры Alibaba Cloud спрогнозировали, что RISC-V станет основной облачной архитектурой в течение 5–8 лет. По данным Reuters, Пекин планирует запустить государственную программу с целью стимулирования широкого использования RISC-V по всей стране. В настоящее время восемь китайских правительственных агентств занимаются подготовкой постановления, которое будет способствовать распространению чипов на базе RISC-V в Китае. Ранее власти призвали китайские компании отказаться от американских чипов в пользу отечественных. Китайский разработчик процессоров Loongson получил возможность участия в пилотном проекте на поставку 10 тыс. ПК китайские школы и контракт на использование его чипов в вычислительной системе на орбитальной станции «Тяньгун», а Lenovo перенесла свой HCI-стек на архитектуру Loongson. Академия наук КНР пообещала в 2021 году выпускать новые проекты на основе RISC-V каждые полгода. Хотя эта цель не была достигнута, в феврале 2025 года академия намекнула на готовящийся мощный проект с использованием RISC-V. В 2023 году технологический гигант Baidu исследовал возможность использования чипов на базе RISC-V уровня ЦОД. В том же году Alibaba сообщила о намерении создать чипы RISC-V для различных сфер, от носимых устройств до облаков. Сейчас крупнейшими коммерческими производителями решений на базе RISC-V в Китае являются XuanTie и Nuclei System Technology, пишет Reuters. На недавнем мероприятии XuanTie было заявлено, что популярность DeepSeek также может стимулировать внедрение RISC-V, поскольку ИИ-модели китайского стартапа эффективно работают на менее мощных чипах. «Даже если решение RISC-V стоимостью ¥10 млн ($1,4 млн) может достичь лишь около 30 % уровня решений NVIDIA или Huawei, три таких комплекта будут всё равно дешевле», — сообщил представитель China Mobile System Integration. В США уже выразили беспокойство по поводу того, что открытая лицензия RISC-V, позволяющая разработчикам использовать архитектуру бесплатно, обеспечит китайским фирмам возможность применять интеллектуальную собственность, созданную в Америке, для разработки передовых технологий. Недавно господдержку запросил и российский альянс RISC-V.

23.02.2025 [22:52], Владимир Мироненко

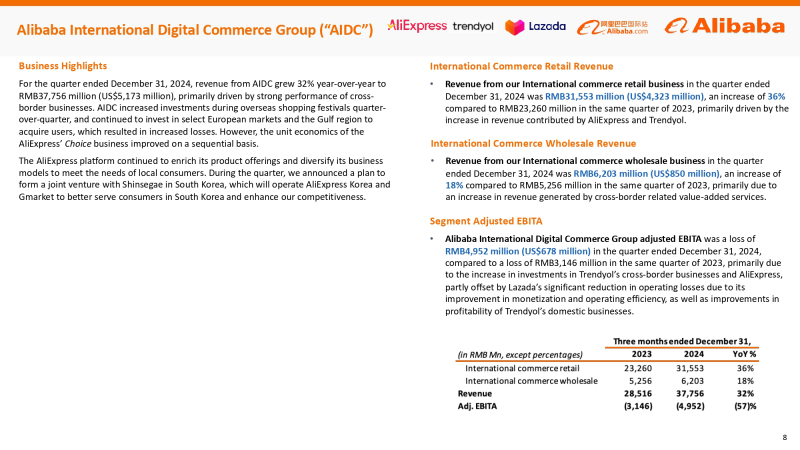

Alibaba в ближайшие три года инвестирует в ИИ и облака $52 млрд — больше, чем за десять лет до этогоAlibaba Group Holding Limited сообщила финансовые результаты III квартала 2024 финансового года, закончившегося 31 декабря 2024 года, которые превысили прогнозы аналитиков. Выручка компании составила ¥280,15 млрд ($38,38 млрд), что на 8 % больше результата аналогичного квартала предыдущего финансового года и выше консенсус-прогноза 17 аналитиков, опрошенных LSEG, в размере ¥279,34 млрд. Инвесторы позитивно оценили квартальные итоги, а также планы китайского технологического гиганта больше инвестировать в электронную коммерцию и ИИ. Благодаря этому на торгах Гонконгской фондовой биржи акции Alibaba поднялись в цене более чем на 10 %, достигнув самого высокого уровня за более чем три года, пишет Reuters. Американские депозитарные расписки компании выросли примерно на 12 % на утренних торгах в Нью-Йорке после публикации результатов, демонстрируя самый большой однодневный процентный прирост с сентября прошлого года, сообщила газета The Wall Street Journal. Согласно Reuters, стоимость акции Alibaba выросла с начала года на 60 %. Чистая прибыль (GAAP), причитающаяся держателям обыкновенных акций, составила ¥48,95 млрд ($6,71 млрд), что значительно превышает прошлогодний результат в размере ¥14,43 млрд ($1,98 млрд) и консенсус-прогноз аналитиков от LSEG в размере ¥40,6 млрд ($5,56 млрд). Чистая прибыль (GAAP) на разводнённую акцию составила ¥2,55 ($0,35). Скорректированная чистая прибыль (Non-GAAP) за квартал составила ¥51,07 млрд ($7,0 млрд), что на 6 % больше результата за III квартал 2023 финансового года. Скорректированная разводнённая прибыль на акцию (Non-GAAP) составила ¥2,67 ($0,37), превысив на 13 % прошлогодний показатель. Скорректированная EBITA выросла на 33 % в годовом исчислении до ¥3,14 млрд ($430 млн). Рост произошёл в основном за счёт сдвига в ассортименте продукции в сторону более прибыльных публичных облачных продуктов и повышения операционной эффективности, что частично компенсировалось ростом инвестиций в развитие клиентской базы и технологий. Международный бизнес электронной коммерции, включающий платформу AliExpress, B2B-площадку Alibaba.com и другие региональные платформы, остался одним из самых быстрорастущих в компании, увеличив выручку на 32 % до ¥37,76 млрд ($5,18 млрд). Выручка подразделения Cloud Intelligence Group компании Alibaba выросла на 13 % с ¥28,07 млрд ($3,85 млрд) в прошлом году до ¥31,74 млрд ($4,35 млрд). Как сообщает компания, рост был обусловлен увеличением внедрения продуктов, связанных с ИИ, выручка от которых сохраняла трехзначный процентный годовой рост шестой квартал подряд. Компания подчеркнула приверженность продвижению мультимодального ИИ и open source. В январе 2025 года Alibaba открыла исходный код Qwen2.5-VL, мультимодальной модели следующего поколения, и запустила флагманскую MoE-модель Qwen2.5-Max. Обе модели доступны пользователям и предприятиям через Qwen Chat и собственную платформу Bailian. С августа 2023 года компания открыла целый ряд различных LLM Qwen. По состоянию на 31 января 2025 года на Hugging Face было разработано более 90 тыс. производных моделей на основе семейства Qwen, что делает его одним из крупнейших семейств ИИ-моделей. Alibaba добилась «значительных успехов» в развитии своего облачного бизнеса в области ИИ после запуска своей флагманской модели Qwen 2.5-Max AI Foundation, сообщила компания Barclays в заметке для инвесторов, добавив, что наблюдается резкий рост спроса на инференс, на который приходится до 70 % всех заказов клиентов. Глава Alibaba Эдди Ву (Eddie Wu) сообщил на встрече с аналитиками, что ИИ — это «та возможность для трансформации отрасли, которая появляется только раз в несколько десятилетий». Он также сказал, что Alibaba вложит в течение следующих трёх лет больше средств в ИИ и облачные вычисления, чем за последнее десятилетие, но не назвал точную сумму. По оценкам Barclays, запланированные инвестиции превысят ¥270 млрд ($37,0 млрд). В этом месяце Alibaba Cloud открыла второй ЦОД в Таиланде в рамках стратегии по расширению присутствия в Юго-Восточной Азии, сообщил ресурс Data Center Dynamics. UPD 24.02.2024: компания официально объявила о намерении инвестировать не менее ¥380 млрд ($52,44 млрд) в облачную и ИИ-инфраструктуру в течение трёх лет.

08.02.2025 [16:14], Сергей Карасёв

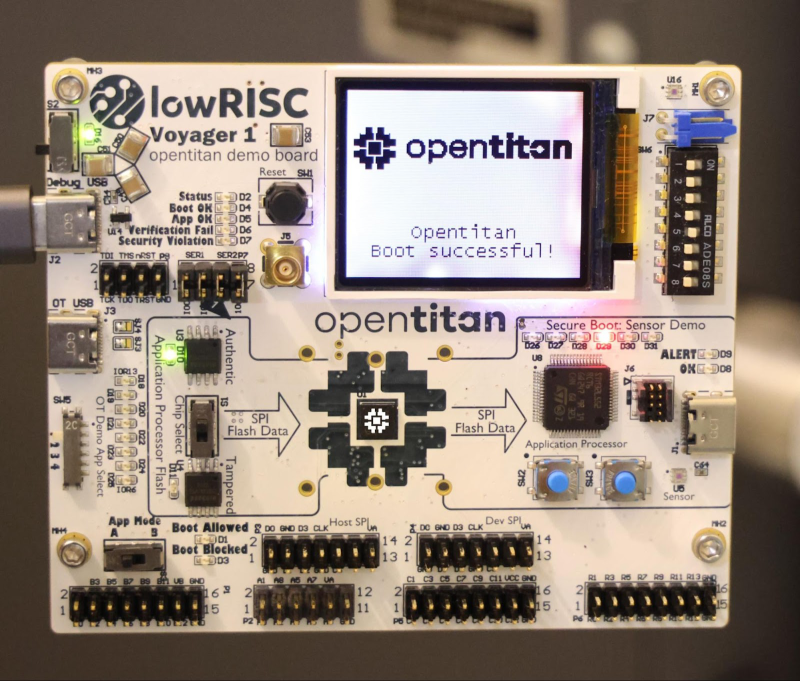

Начато производство первых чипов безопасности на открытой платформе OpenTitanКорпорация Google объявила о начале производства первого чипа, построенного на аппаратной платформе с открытым исходным кодом OpenTitan. Целью инициативы является создание открытой, доступной и надёжной аппаратной реализации Root of Trust (RoT). Проект OpenTitan был начат с нуля в 2018 году. Помимо Google, в нём участвуют Nuvoton, Швейцарская высшая техническая школа Цюриха (ETH Zurich), G+D Mobile Security, lowRISC, Rivos, Seagate, Western Digital, Winbond, zeroRISC и др. Первый чип на базе OpenTitan, пока не получивший определённого названия, изготавливается компанией Nuvoton. Изделие использует архитектуру RISC-V. Отмечается, что в ближайшее время чип станет доступен в составе демонстрационной платы Voyager 1 от lowRISC, а позднее в текущем году появится в хромбуках и решениях для дата-центров. Целью проекта OpenTitan является обеспечение безопасной загрузки критически важных компонентов системы с использованием авторизованного и открытого кода. Чипы OpenTitan могут применяться в самом разном оборудовании — от серверных материнских плат, сетевых карт и маршрутизаторов до потребительских устройств и IoT-продуктов. Google и другие участники инициативы предоставляют исходный код, а также руководства по интеграции и эталонную прошивку. Ожидается, что в перспективе OpenTitan создаст основу, позволяющую повысить уровень доверия к ИТ-платформам и снизить издержки при разработке специализированных чипов для обеспечения безопасности. В настоящее время Nuvoton поставляет образцы изделий OpenTitan для тестирования и оценки, а массовое производство намечено на весну нынешнего года.

31.01.2025 [08:46], Владимир Мироненко

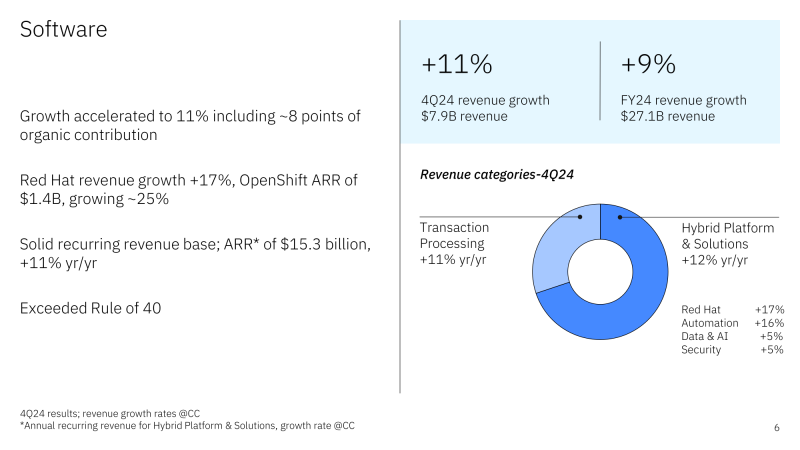

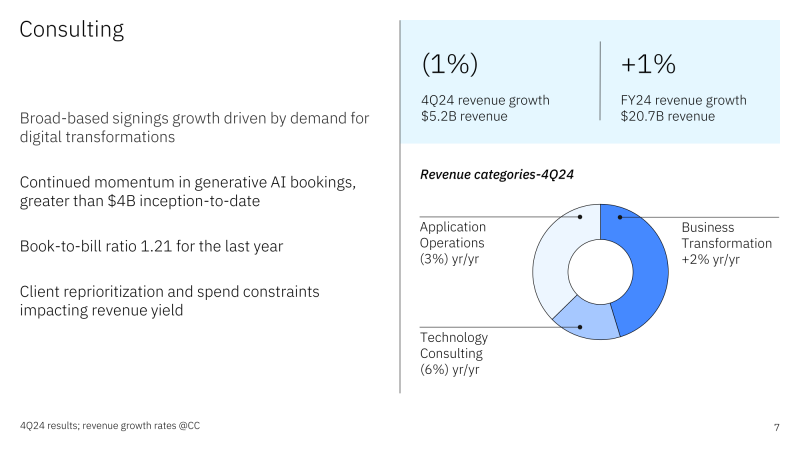

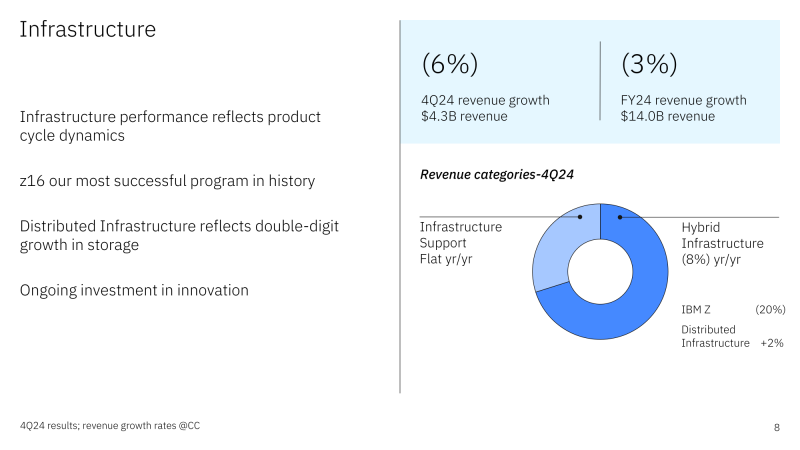

Почти половина бизнеса IBM теперь приходится на ПО — компания делает ставку на ИИ и open sourceИнвесторы поддержали стратегию развития IBM направления, касающегося развёртывания технологий ИИ, что нашло выражение в росте акций после публикации компанией отчёта за IV квартал и 2024 финансовый год, завершившийся 31 декабря, пишет газета The Wall Street Journal. Также свою роль сыграло то, что основные показатели IBM превысили прошлогодние результаты и прогнозы Уолл-стрит. Ранее IBM объявила, что приняла подход открытых инноваций к ИИ, открыв исходный код своих решений. В мае компания выпустила открытые модели Granite Foundation, а до этого она вместе с NASA сделала открытой базовую ИИ-модель для анализа спутниковых данных и выложила её на Hugging Face. Финансовый директор IBM Джеймс Кавано (James Kavanaugh) отметил, что стратегия open source делает технологию более экономически эффективной и более простой в масштабировании. Это соответствует подходу китайского стартапа DeepSeek, ИИ-модели которого вызвали шок на рынке. Общая выручка IBM за IV квартал увеличилась на 1 % до $17,6 млрд, что соответствует ожиданиям аналитиков, опрошенных LSEG. При этом скорректированная прибыль на разведённую акцию (Non-GAAP) составила $3,92 при прогнозе аналитиков $3,75. Чистая прибыль (GAAP) IBM за квартал составила $2,92 млрд или $3,09 на разведённую акцию, тогда как годом ранее эти показатели равнялись $3,29 млрд и $3,55 на акцию. Подразделение ПО увеличило выручку в годовом исчислении на 10 % до $7,92 млрд, чему способствовал рост выручки Red Hat на 16 %. Платформа OpenShift обеспечила почти половину этого объёма. Выручка подразделения по автоматизации увеличилась на 15 %, подразделения по обработке данных и ИИ — на 4 %. Компания отметила, что объём бизнеса в сфере генеративного ИИ теперь составляет более $5 млрд, что почти на $2 млрд больше, чем кварталом ранее. Гендиректор IBM Арвинд Кришна (Arvind Krishna) сообщил, что на ПО теперь приходится около 45 % бизнеса IBM с годовым оборотом более $15 млрд и двузначным ростом. Продажи консалтингового подразделения IBM снижаются четвёртый квартал подряд, на это раз на 2 % до $5,18 млрд. Клиенты продолжают перенаправлять средства из традиционных консалтинговых проектов в проекты, ориентированные на ИИ, сообщил Кавано, отметив, что скорее всего, это временно. «Мы завершили год с самым высоким в истории зафиксированным количеством заказов за квартал, рост — на 23 %, — сказал он. — Мы по-прежнему имеем дело с очень динамичной средой вокруг того, как клиенты расставляют приоритеты в расходах». Около 80 % заказов поступает от консалтингового подразделения, а остальное — от подразделения ПО. Выручка инфраструктурного подразделения снизилась в отчётном квартале на 7,6 % до $4,26 млрд, что отражает приближающееся окончание трёхлетнего жизненного цикла мейнфреймов z16, продажи которых упали на 21 %. Ожидается, что следующее поколение z17 выйдет в середине года, что обеспечит рост доходов во II полугодии 2025-го. За весь 2024 финансовый год выручка IBM составила $62,8 млрд, превысив показатель 2023 финансового года на 1 %. Подразделение ПО увеличило выручку на 8 %, а у консалтингового подразделения этот показатель снизился на 1 %. У инфраструктурного подразделения выручка упала больше — на 4 %. В 2025 году IBM ожидает рост выручки не менее чем на 5 %. После публикации финансового отчёта акции компании выросли на внебиржевых торгах на 9 %, сообщил ресурс SiliconANGLE. За последние 12 месяцев цена акции IBM увеличилась на 22 %. Как отмечает The Register, компания сэкономила $3,5 млрд на операционных расходах в прошлом году и намеревается сэкономить столько же в 2025-м, что косвенно указывает на новую волну увольнений. В 2024 году их было как минимум две. Сведения о размере штата компания не обновляла уже больше года.

27.01.2025 [13:16], Сергей Карасёв

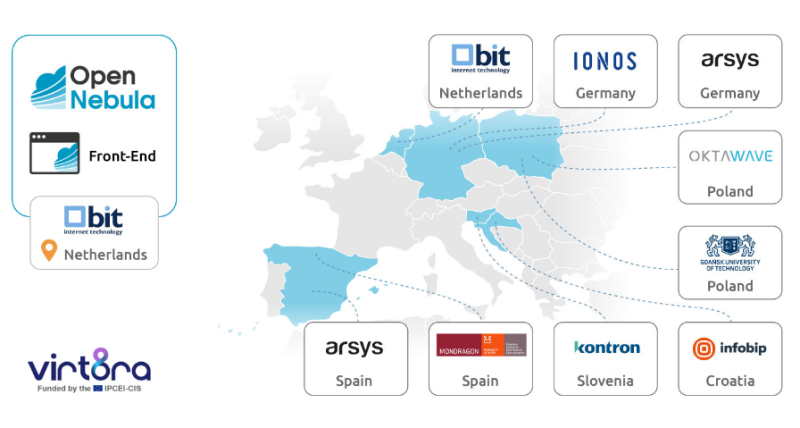

В Евросоюзе появится суверенная облачная платформа Virt8raРяд европейских технологических организаций, по сообщению ресурса ITPro, объединили усилия с целью создания суверенной облачной платформы, призванной обеспечить переносимость и совместимость между сервисами различных поставщиков облачных услуг. Проект получил название Virt8ra. В инициативе принимают участие Arsys, BIT, Гданьский политехнический университет (Gdańsk Tech), Infobip, IONOS, Kontron, Mondragon и Oktawave, а координатором выступает OpenNebula Systems. Вычислительные мощности и ресурсы хранения данных планируется предоставлять во многих странах Евросоюза, включая Хорватию, Нидерланды, Польшу, Германию, Словению и Испанию. «Благодаря этому сотрудничеству мы вносим вклад в укрепление цифрового суверенитета Европы и стимулируем инновации на всём континенте», — отметил Йоже Орехар (Jože Orehar), руководитель подразделения облачных платформ Kontron. Virt8ra является частью масштабной программы IPCEI-CIS (Important Project of Common European Interest on Next Generation Cloud Infrastructure and Services) — это европейский проект развития облачной инфраструктуры и услуг следующего поколения. Инициатива, одобренная Европейской комиссией в декабре 2023 года, поддерживается 12 государствами — членами ЕС. Проект направлен на стимулирование исследований и увеличение инвестиций в технологии периферийных и облачных вычислений в ЕС, а также на создание децентрализованной периферийной инфраструктуры. В рамках Virt8ra более 30 европейских компаний разрабатывают стек ПО с открытым исходным кодом для виртуализации. Целью является создание надёжной системы для управления цифровыми инфраструктурами, которая предоставит европейским предприятиям и государственным организациям улучшенную гибкость, технологический суверенитет и возможность получить полный контроль над своими IT-средами без ограничений, связанных с действующими моделями лицензирования и поддержки. Инфраструктура Virt8ra рассматривается как способ снижения зависимости компаний и госструктур Евросоюза от гиперскейлеров и облачных провайдеров из США. Текущая версия платформы поддерживает централизованное управление физическими ресурсами, виртуальными машинами и кластерами Kubernetes, а также обеспечивает возможность миграции, что позволяет клиентам развёртывать, запускать и переносить приложения между разными регионами и поставщиками облачных услуг.

23.01.2025 [13:29], Руслан Авдеев

В Nebius AI Studio появились открытые ИИ-модели для преобразования текста в изображениеИИ-компания Nebius B.V. (бывшая Yandex N.V.) анонсировала обновление платформы «инференс как услуга» для разработчиков. В частности, добавлены новые open source модели, предназначенные для преобразования текста в изображение, сообщает Silicon Angle. В скором времени в сервисе появятся модели для преобразования текста в видео. Nebius AI Studio представляет собой гибкую, удобную для пользователей среду для разработчиков, решивших заняться созданием ИИ-приложений, говорит компания. Помимо обеспечения доступа к обширному набору больших языковых моделей (LLM), решение является одним из самых доступных с точки зрения стоимости. Поскольку компания управляет своей собственной облачной инфраструктурой, она может обеспечить одну из самых низких цен за токен на рынке, подчёркивает Nebius. Кроме того, предлагается гибкая ценовая модель — чем больше ресурсов потребляется, тем они дешевле. Ранее компания называлась Yandex N.V. — это была родительская структура российского «Яндекса». Позже она продала поисковый и некоторые другие бизнесы, но сохранила ЦОД за пределами России (и даже намерена строить новые) и, наконец, превратилась в облачный инфраструктурный ИИ-сервис. На этой инфраструктуре и работает Nebius AI Studio. Обновление добавило модели Flux Schnell и Flux Dev, разработанные ИИ-стартапом Black Forest Labs Inc. — позиционирующим себя как одного из конкурентов OpenAI. Разработчики, создающие ИИ-приложения в Nebius AI Studio, смогут напрямую интегрировать в них новые модели. В компании утверждают, что она обеспечивает одну из самых высоких скоростей рендеринга — изображения создаются за секунды. Приложения, создаваемые с использованием Nebius AI Studio, могут поддерживать обработку до 100 млн токенов в минуту, сообщает пресс-служба компании.

31.12.2024 [14:02], Сергей Карасёв

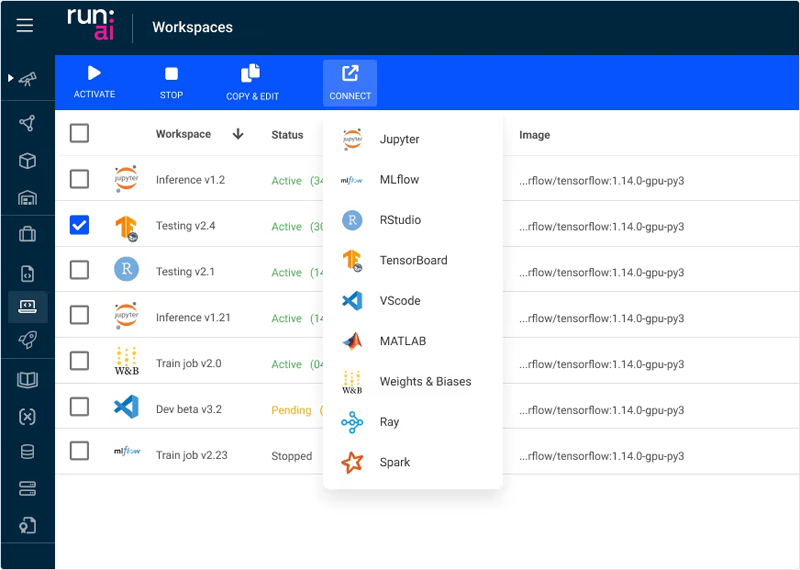

NVIDIA закрыла сделку по покупке Run:ai: исходный код ПО стартапа будет открытNVIDIA завершила сделку по приобретению стартапа Run:ai, разрабатывающего ПО для управления рабочими нагрузками ИИ и оркестрации на базе Kubernetes. Стоимость купленной компании, по оценкам, составила около $700 млн. О поглощении Run:ai корпорация NVIDIA объявила в апреле 2024 года. Но сделка вызвала вопросы у американских и европейских регуляторов. Дело в том, что NVIDIA доминирует на мировом ИИ-ускорителей с долей примерно 80 %. Высказывались предположения, что NVIDIA приобретает Run:ai с тем, чтобы в дальнейшем поставить крест на технологиях стартапа, которые сокращают потребность в ИИ-ускорителях и тем самым могут негативно повлиять на продажи продуктов NVIDIA. Антимонопольный орган Евросоюза изучал вопросы, связанные с тем, ставит ли сделка под угрозу конкуренцию на рынках, где работают компании. В результате, регулятор пришёл к выводу, что деятельность NVIDIA и Run:ai не пересекается, а поэтому слияние не создаст проблем с конкуренцией в Европейской экономической зоне. Еврокомиссия одобрила сделку, и теперь все необходимые процедуры завершены.

Источник изображения: Run:ai В заявлении Run:ai говорится, что стартап намерен открыть исходный код своего ПО, чтобы «помочь сообществу в создании лучшего ИИ». Наблюдатели отмечают, что данный шаг призван развеять опасения, касающиеся монополизации рынка. «Хотя в настоящее время Run:ai поддерживает только GPU NVIDIA, открытие исходного кода позволит расширить доступность решений для всей экосистемы ИИ», — заявляет стартап. Отмечается, что в составе NVIDIA компания Run:ai продолжит развивать своё семейство продуктов, расширять штат и укреплять положение на рынке. Цель Run:ai остаётся прежней — оказывать помощь клиентам в извлечении максимальной пользы из своей инфраструктуры ИИ. Стартап намерен укреплять партнёрские отношения и взаимодействовать с участниками экосистемы, чтобы предоставлять широкий спектр решений ИИ и вариантов платформ. |

|